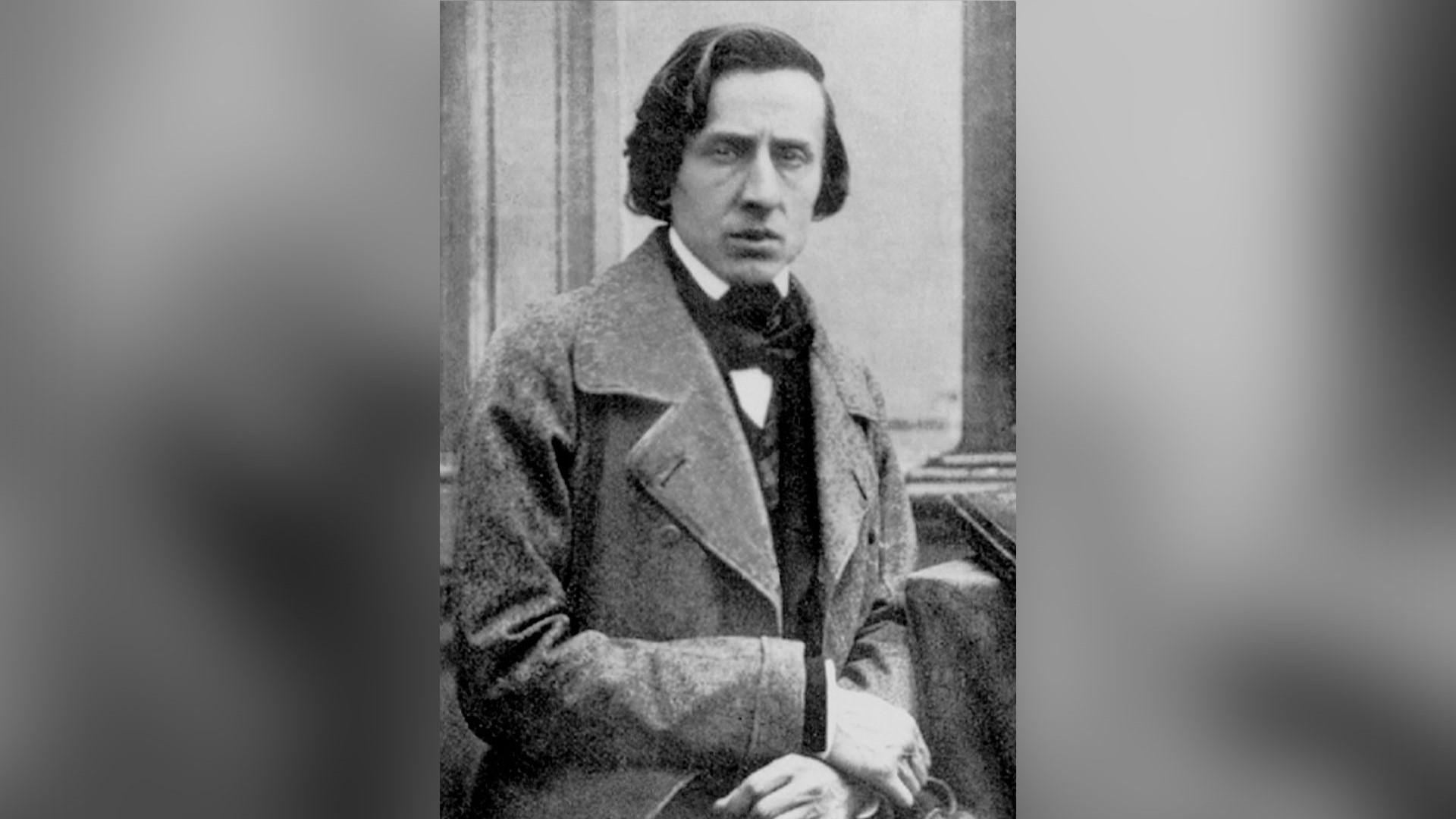

Den berömde teoretiske fysikern Stephen Hawking har väckt liv i debatten om huruvida vårt sökande efter förbättrad artificiell intelligens en dag kommer att leda till att maskinerna tar över.

Den brittiske forskaren gjorde påståendet under en vittomfattande intervju med BBC. Hawking har sjukdomen amyotrofisk lateralskleros (ALS), och intervjun berörde den nya teknologi han använder för att hjälpa honom att kommunicera.

Den fungerar genom att modellera hans föregående ordanvändning för att förutspå vilka ord han kommer att använda därefter, på liknande sätt som förutsägelsefunktionen när man skriver på många smarta mobiltelefoner.

Men Hawking nämnde också sin oro över utvecklingen av maskiner som kan överträffa oss.

”När människan väl har skapat artificiell intelligens kommer den att ta över och skapa om sig själv i en allt högre hastighet”, sade han till BBC.

”Utvecklingen av full artificiell intelligens skulle kunna innebära slutet för den mänskliga rasen.”

Kan tänkande maskiner ta över?

Jag uppskattar att frågan om huruvida datorer kan ta över (och en dag innebära slutet för mänskligheten) tas upp av en så känd, kunnig och trovärdig person som professor Hawking – och den förtjänar ett snabbt svar.

Den brittiske professorn i teoretisk fysik, Stephen Hawking, talar med media på en presskonferens i London den 2 december 2014. (Justin Tallis/AFP/Getty Images)

Frågan om intelligenta maskiner går så långt tillbaka i tiden som till den brittiske kodknäckaren och fadern till datorvetenskapen, Alan Turing, på femtiotalet, då han ställde frågan: ”Kan maskiner tänka?”

Att dessa intelligenta maskiner ska ta över har diskuterats på ett eller annat sätt i en mängd olika populärkulturer. Tänk på filmerna ”Colossus: The Forbin project” (1970), ”Westworld” (1973), och Skynet i filmen ”Terminator” från 1984 och dess uppföljare, för att bara nämna några.

Gemensamt för alla dessa filmer är frågan om att ansvar ges till maskinerna. Begreppet teknologisk singularitet (eller maskinell superintelligens) går tillbaka i tiden åtminstone till pionjären inom artificiell intelligens, Ray Solomonoff, som 1967 varnade:

”Även om det inte finns några särskilt intelligenta maskiner i sikte inom en nära framtid, så är de faror som de utgör allvarliga och problemen mycket svåra. Det skulle vara bra om ett stort antal intelligenta människor ägnar de här problemen en hel del tankemöda innan de uppstår.”

”Min känsla är att förverkligandet av artificiell intelligens kommer att ske plötsligt. Vid en viss punkt i forskningsutvecklingen kommer vi att sakna praktisk erfarenhet av seriös maskinintelligens. En månad senare eller så kommer vi att ha väldigt intelligenta maskiner och alla problem och faror som följer av vår oerfarenhet.”

Förutom den variant på Hawkings varning som Solomonoff gav 1967, så försökte han också att 1985 ge en tidsskala för den teknologiska singulariteten, samt reflektera över de sociala effekterna.

Jag delar Solomonoffs, Hawkings och andras oro beträffande konsekvenserna av snabbare och mer intelligenta maskiner – men den amerikanske författaren, datorforskaren och uppfinnaren Ray Kurzweil är en av många som ser fördelarna.

Vem som än får rätt (förutsatt att vår planet inte förstörs av någon annan fara under tiden) så tror jag att Solomonoff var förutseende 1967 när han förespråkade att vi bör tänka över detta noga.

Maskinerna tar redan över

Samtidigt ser vi hur allt större ansvar läggs på maskinerna. Å ena sidan kan detta vara bärbara miniräknare, rutinmässiga matematiska beräkningar eller globala positioneringssystem (GPS).

Å andra sidan kan detta vara system för flygtrafikkontroll, missiler, förarlösa truckar i gruvor eller de förarlösa bilar som nyligen börjat testas.

Människan lämnar över ansvaret till maskiner av olika skäl, som att det sparar tid, kostnader och ger ökad precision. Men skador på grund av förarlösa fordon skulle till exempel medföra juridiska, försäkringsmässiga och ansvarsmässiga problem.

Det hävdas att datorer kan komma att ta över när deras intelligens överskrider människans. Men det finns också andra risker med det här överlämnandet av ansvar.

Misstag i maskinerna

Somliga skulle hävda att kraschen på aktiemarknaden 1987 till stor del berodde på datorhandel.

Det har också hänt att kraftnät har stängts ned på grund av datorfel. Ett enklare exempel är att min påträngande stavningskontroll ibland ”korrigerar” det jag skrivit till något potentiellt anstötligt. Datorfel?

Tekniska fel i mjukvara eller hårdvara kan vara svåra att upptäcka men kan ändå skapa förödelse i storskaliga system – också utan hackers eller onda avsikter, och förmodligen ännu mer med dem. Exakt hur mycket kan vi då anförtro maskinerna det stora ansvaret att göra ett bättre jobb än oss?

Även utan att datorerna medvetet tar kontrollen kan jag föreställa mig flera sätt på vilka datorsystem kan hamna bortom vår kontroll. De här systemen kan vara så snabba och ha så små komponenter att de kan vara svåra att rätta till och till och med svåra att stänga av.

Delvis i samma anda som i Solomonoffs artikel från 1967 skulle jag vilja se att manusförfattare och forskare inom artificiell intelligens samarbetar och skapar sådana scenarier för att ytterligare stimulera offentliga diskussioner.

I ett möjligt scenario kanske ett tal blir dåligt konverterat till text, förvärrat i en dålig automatisk översättning, vilket leder till en liten försämring av maskininstruktioner, och i förlängningen ett teknologiskt gungfly.

En annan problematisk situation kan uppstå genom snabbare statistisk analys med maskininlärning av stora datamängder om den mänskliga hjärnan. (Och, som många skulle drista sig att tillägga, är vi människor verkligen en bastion för allt som är gott, moraliskt och korrekt?)

Som Solomonoff sade 1967 så behöver vi denna offentliga diskussion – och jag tror att vi behöver den snart.

David Dowe är docent på Clayton School of Information Technology på Monash University.

Artikeln publicerades ursprungligen på The Conversation. Läs originalartikeln på engelska här.